In mezzo alle novità del Google I/O, Big G ha lanciato una bomba che cambierà il modo in cui cerchiamo le informazioni online: il Multitask Unified Model (MUM).

Google sta mostrando già da tempo un interesse sempre più elevato alla naturalezza delle “conversazioni” tra gli utenti e i motori di ricerca. MUM è un enorme passo avanti in questo percorso, e sfrutta l’intelligenza artificiale per trovare le migliori risposte alle intenzioni degli utenti. Ma di cosa stiamo parlando?

Per capire meglio il Multitask Unified Model dobbiamo fare un piccolo passo indietro, esaminando i punti di contatto fra l’intelligenza artificiale e Big G.

Il rapporto di Google con l’IA

Il Multitask Unified Model è un’evoluzione di BERT (Bidirectional Encoder Representations from Transformer), l’aggiornamento che nel 2019 ha rivoluzionato la scienza del Natural Language Processing (NLP) nell’ambito dei motori di ricerca.

L’idea dietro BERT era semplice ma geniale: per capire cosa hanno in mente gli utenti quando fanno una ricerca su Google, perché non rendere Google più simile a una mente umana?

Il Natural Language Processing cerca di fare esattamente questo: unisce l’informatica, la linguistica e l’intelligenza artificiale per analizzare un documento, capire le relazioni che intercorrono fra i vari termini e cercare di rappresentare il linguaggio umano attraverso una serie di processi granulari.

Esaminando un testo, gli algoritmi di NLP più raffinati riescono a capire:

- A che categoria morfologica appartengono i singoli termini: nomi, verbi, avverbi e aggettivi.

- A che entità fanno riferimento: luoghi, persone, date.

- Se c’è una relazione sintattica fra i termini: chi è il soggetto, quali sono le sue qualità.

- La semantica del testo: qual è il tono di voce utilizzato? Emerge del sarcasmo, o qualche altro sentimento umano? Di quale argomento si parla?

Per imparare dai loro errori e migliorare nel tempo la loro accuratezza, questi algoritmi sfruttano tecnologie di deep learning, che permettono loro di memorizzare tutte le informazioni importanti e liberarsi dei dettagli meno significativi.

Il deep learning si basa su enormi dataset di informazioni, che gli algoritmi trattengono e collegano fra loro. In questo processo di memorizzazione, i collegamenti si consolidano e l’algoritmo “impara” ogni volta qualcosa di nuovo, proprio come la mente umana.

Non è un caso che in questo ambiente si parli spesso di reti neurali artificiali: lo scopo del NLP e del deep learning è simulare il funzionamento delle sinapsi, costruendo programmi in grado di risolvere un problema attraverso quello che hanno imparato dai dataset che analizzano.

Google BERT: Context is king

BERT ha portato tutte le evoluzioni del NLP su Google, per risolvere l’enigma che il motore di ricerca affronta ogni giorno: quando un utente digita una query, cosa vuole sapere davvero?

Prima di BERT, era pressoché impossibile ottenere dei risultati precisi con una ricerca complessa, fatta di frasi lunghe, tipiche di una conversazione. Cercare “Puoi ritirare un medicinale per qualcun altro in farmacia” avrebbe prodotto una SERP confusionaria, perché a Google non era chiaro cosa intendesse l’utente. Il motore di ricerca avrebbe capito “ritirare un medicinale” e “farmacia”, ma non la relazione fra questi termini.

Grazie a questo aggiornamento, Google ha imparato a riconoscere meglio la complessità, analizzando il contesto della query e mettendo in relazione logica e semantica le parole che la compongono.

Se oggi dovesse leggere “Puoi ritirare un medicinale per qualcun altro in farmacia”, Big G capirebbe alla perfezione i bisogni dell’utente, che non vuole qualche consiglio generico su come recarsi in farmacia, ma vuole sapere esattamente come funziona quando a stare male è una terza persona.

Immaginatevi un processo di comprensione così raffinato, tutto il lavoro di fino che c’è stato dietro, gli immensi dataset che sono serviti per “nutrire” la mente di Google. Ecco, ora moltiplicate tutti questi aspetti per 1000 e otterrete il nuovo algoritmo MUM.

I numeri di MUM

Il numero 1000 non è casuale: Google MUM usa la stessa tecnologia di BERT, ma la sua rete neurale è letteralmente mille volte più estesa. L’obiettivo del nuovo aggiornamento è facilitare il lavoro di interpretazione del motore di ricerca e migliorare la soddisfazione degli utenti che lo utilizzano.

Per ora, sappiamo che MUM ha delle caratteristiche uniche nel suo genere:

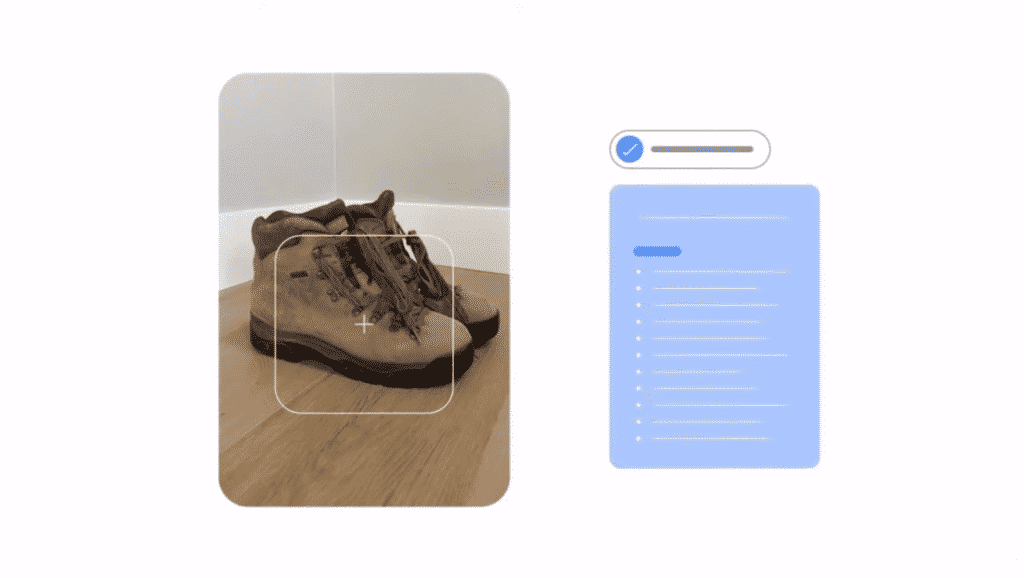

- È un programma multimodale, cioè che riesce a leggere simultaneamente le informazioni di un’immagine e una porzione di testo e a capire di cosa trattino. Per il futuro, si parla di implementare anche il riconoscimento di video e audio.

- È stato addestrato in 75 lingue diverse contemporaneamente, mentre la maggior parte dei modelli NLP ha bisogno di “studiare” una lingua per volta. MUM è in grado di comprendere e parlare ciascuna di queste lingue, cioè sa leggere e creare informazioni.

- Ha una conoscenza del mondo molto più ampia e stratificata rispetto a ogni altro algoritmo visto finora, grazie all’enorme quantità di informazioni che sta imparando.

Cosa rappresenta questo aggiornamento?

Per capire meglio il Multitask Unified Model, riprendiamo l’esempio fatto da Pandu Nayak, vicepresidente di Google Search. Immaginiamo di avere scalato di recente il monte Adams e di voler provare col monte Fuji il prossimo autunno. Faremo quindi una ricerca su Google per sapere come prepararci.

Con le regole attuali di Google, questa ricerca è molto semplice, ma richiede tempo. Una sessione-tipo avrà questa forma:

- Cerchiamo “quando scalare monte Fuji” per sapere se l’autunno è il periodo migliore. Leggiamo due o tre articoli, poi riprendiamo in mano la barra di ricerca.

- Vogliamo sapere se online si trova qualche percorso facile per l’escursione. La query “consigli escursione sul monte Fuji” potrebbe esserci utile.

- Arriva poi il turno di “Attrezzatura da arrampicata sconti”: non sapendo se l’attrezzatura che già abbiamo è sufficiente, è sempre meglio essere pronti.

- Infine, una volta cercata l’attrezzatura adatta, occorrerà prepararsi fisicamente e mentalmente all’impresa: “Allenamento intensivo hiking”.

Tramite MUM, tutte queste sessioni di ricerca verranno riunite in un’unica pagina dei risultati. Secondo Nayak, quando l’aggiornamento sarà completamente operativo potremo porre a Google questa domanda:

Si tratta di una domanda molto complessa, formulata come una conversazione qualsiasi fra persone: proprio quel genere di query che Google non era in grado di capire fino in fondo. Grazie a MUM, questa domanda così “naturale” troverà una risposta chiara e univoca, la stessa che darebbe un esperto giapponese di escursionismo: un autentico capolavoro di deep learning.

Troveremo una SERP incredibilmente complessa, che recherà articoli tradotti dal giapponese che spiegano il percorso da fare e il momento migliore per affrontare il monte Fuji, schede prodotto per comprare l’attrezzatura adatta, post sull’allenamento intensivo per fare escursionismo in sicurezza e via dicendo.

Addirittura, potremo fare una foto ai nostri scarponi da camminata e chiedere a Google “Questo modello va bene per un’escursione sul Monte Fuji?”. Il motore di ricerca troverà una risposta anche a questa query, grazie alle doti multimodali di MUM.

Cosa succederà ai contenuti?

Anche se passeranno anni prima di una completa implementazione di MUM, possiamo già capire quali contenuti verranno premiati e quali saranno invece destinati al dimenticatoio. È molto semplice: prendiamo le indicazioni che ci sono arrivate da BERT e moltiplichiamole per 1000!

Dovremo dire addio per sempre ai contenuti scarni e alle ripetizioni ad nauseam delle keyword, facendo invece spazio agli intenti di ricerca. La scrittura sarà più vicina all’utente e al suo modo di esprimersi, con un occhio di riguardo alla colloquialità e alla spontaneità delle ricerche vocali.

Entrare nelle grazie di Google non è mai stato così semplice: dovremo pensare ai nostri utenti e scrivere per loro, senza manipolazioni di sorta. La differenza fra un posto al sole della SERP e la cinquantesima posizione la faranno i contenuti facili da navigare, ricchi di spunti originali, che lasciano intendere una notevole expertise sul tema di cui ci occupiamo. Al resto ci penserà MUM.

Qui sotto trovi l’estratto del Google I/O incentrato sul Multitask Unified Model. Noi non vediamo l’ora che arrivi, e tu?

Cosa possiamo fare per te

Se questo articolo ti ha fatto capire che hai bisogno di contenuti efficaci e appassionati per il tuo target, contattaci per saperne di più! LinkJuice è l’agenzia di Digital PR, Link Building, SEO e Brand Reputation che può supportare al meglio la tua idea di business digitale e seguirti passo dopo passo per potenziarla al massimo, aumentando i ricavi del tuo progetto.